Em meus anos lidando com integrações fiscais, percebi que “montar o ambiente de teste para API NFS-e” não é apenas uma etapa técnica, mas um passo estratégico para qualquer negócio que deseja automatizar a emissão de notas fiscais de serviço. O cuidado na preparação pode salvar muitos dias de dor de cabeça, além de evitar surpresas desagradáveis quando tudo já estiver em produção. Neste artigo, quero compartilhar minha visão detalhada de como estruturar, do absoluto zero até o deploy, um ambiente de testes robusto para API NFS-e. Usando boas práticas que sempre adoto, relato aprendizados, atalhos e detalhes ignora dos em guias superficiais.

E se você busca avançar no tema, recomendo consultar conteúdos como o Guia completo de emissão e integração de NFS-e por API, mas hoje quero que você compreenda na prática tudo que envolve montar um ambiente de testes sério e confiável, usando, sempre que possível, recursos modernos oferecidos por plataformas como o Notaas.

O início: por que preciso de um ambiente de teste para API NFS-e?

No meu cotidiano, vejo muitas dúvidas nesse ponto. Afinal, por que criar um ambiente à parte só para testes de API NFS-e? Não dá para usar direto o que está pronto em produção?

A resposta curta é: seu negócio ganha segurança, legalidade e flexibilidade ao separar bem testes de execução em produção. O ambiente de teste protege seus dados reais e permite simular cenários diversos sem prejuízos, sem acionar a prefeitura sem necessidade e sem colocar clientes ou operações em risco.

Ambientes de teste evitam sustos fiscais no futuro e te ajudam a ganhar confiança na homologação dos serviços.

Aliás, montar esse ambiente não se resume a isolar um servidor ou banco de dados, mas engloba desde a configuração dos certificados digitais à análise detalhada das respostas dos webservices municipais. A seguir, mostro como começar do zero.

Entendendo a API NFS-e: o que olhar antes de montar?

Comece estudando atentamente a documentação da API NFS-e escolhida. Garanta que você entende:

- Os endpoints disponíveis: emissão, consulta, cancelamento de NFS-e;

- Autenticação exigida (token, OAuth2, certificado digital, etc.);

- Formato de envio dos dados (JSON, XML...);

- Detalhes das respostas (estrutura, status HTTP, erros, dicas);

- Particularidades do município onde atuará.

Neste assunto, o Notaas se destaca porque oferece uma API uniforme para todo o Brasil, facilitando integrações em múltiplas cidades, um problema conhecido para quem já tentou usar APIs municipais diferentes.

Se você quer um panorama sobre como APIs funcionam no geral, pode se aprofundar no artigo endpoint API: Guia prático de integração e segurança, que explica o básico sobre endpoints e segurança, temas constantemente negligenciados por quem está começando.

Pré-requisitos técnicos: o que vou precisar para o teste?

Depois de entender a teoria, listei abaixo os pontos essenciais que sempre analiso antes de começar qualquer ambiente de testes:

- Servidor dedicado para testes: Pode ser um VPS barato, um container Docker ou até só uma máquina local bem configurada. Separe sempre da produção!

- Sandbox de API: Verifique se a plataforma oferece ambiente de sandbox (como o Notaas faz). Isso evita o uso de dados reais e de valores fiscais nas notas fake de teste.

- Ambiente controlado para banco de dados: Nunca use o banco de dados de produção nos testes. Use schemas separados ou bancos distintos.

- Ferramentas de automação de requisições: Postman, Insomnia, curl, scripts em Python ou Node.js; escolha a que preferir.

- Certificado digital (quando exigido): Em muitos casos, mesmo ambiente de testes pede um certificado digital A1 ou A3 válido.

- Dados simulados de prestador e tomador: Gere CNPJ, CPF e demais dados fictícios, seguindo o padrão de cada município.

- Acesso à documentação oficial do provedor da API (ou da prefeitura): Sempre ao alcance para dúvidas rápidas.

Se algum desses pontos faltar, pare e resolva antes de seguir. Não tente “pular etapas”, esse é um erro comum que custou caro para muitas empresas com quem já trabalhei.

Configurando tudo: primeiros passos no setup do ambiente

Agora começo o setup de verdade. Gosto de dividir em etapas claras, documentando cada ajuste feito:

Separando ambiente de testes e produção

Crie infraestrutura realmente isolada:

- Nomes e endereços de API diferentes para cada ambiente;

- Variáveis de ambiente (ENV) específicas para cada configuração;

- Bancos de dados distintos ou pelo menos schemas separados;

- Usuários e permissões desconectados do ambiente de produção.

Ambiente de testes deve estar inacessível externamente, protegido por firewall, VPN ou restrições de IP.

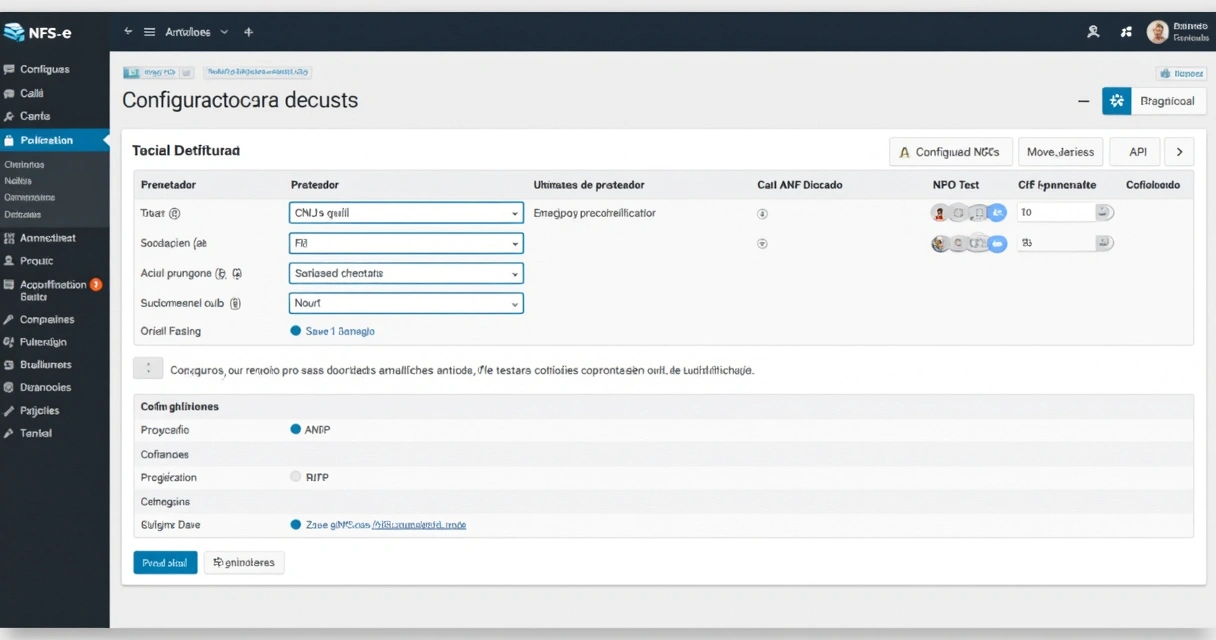

Solicitando e configurando certificados digitais

Grande parte das APIs municipais exige certificado digital para autenticação, mesmo em ambiente de homologação. No Notaas, essa validação ocorre uma vez e, depois de aprovada, já permite emitir em produção e homologação tranquilamente. Instale o certificado A1 no ambiente e teste a leitura com ferramentas como OpenSSL (Linux) ou CertUtil (Windows).

Gerando dados simulados e organizando o banco de dados

Crie um conjunto de dados fictícios de prestador e tomador:

- CNPJ e inscrição municipal válidos, mas que não correspondem a empresas reais;

- Endereços e informações consistentes, mas fictícias;

- Serviços cadastrados seguindo a Lei Complementar 116/2003;

- Tabelas específicas para logs e registros de teste;

- Limpeza fácil dos dados de teste no banco, sem risco de “sujar” produção.

Eu sempre lembro: simulação próxima da realidade garante que nada diferente será encontrado após o deploy final. Adapte os dados ao máximo para o município-alvo, já que políticas variam bastante em cada prefeitura.

Eu sempre lembro: simulação próxima da realidade garante que nada diferente será encontrado após o deploy final. Adapte os dados ao máximo para o município-alvo, já que políticas variam bastante em cada prefeitura.

Testando requisições: do Postman ao código real

Muitos desenvolvedores acham que basta rodar um “Hello World” da API e pronto, mas minha experiência mostra que há muitos detalhes a verificar durante essa fase.

Testando manualmente com Postman ou Insomnia

- Cadastre o endpoint sandbox da API NFS-e;

- Configure o método HTTP, headers e o payload conforme especificação;

- Inclua autenticação: token, OAuth ou certificado digital (o Postman suporta A1, mas A3 exige mais ajustes);

- Envie requisições e analise respostas. Anote códigos de erro, payloads retornados, tempos de resposta.

Neste estágio, erro algum assusta. Se algo não está batendo com a documentação, revise as variáveis e dados enviados. Muitas vezes, pequenos detalhes de formatação, como strings numéricas ou campos opcionais, fazem toda diferença.

Automatizando testes no código

Após testar manualmente, parto para scripts automáticos, geralmente em Python, Node.js ou usando ferramentas de teste integradas ao projeto (como pytest, jest etc.). Os scripts permitem:

- Repetir cenários completos sem medo de esquecer etapas;

- Simular alta volumetria de requisições para testar performance (estoque, múltiplos tomadores, notas canceladas...);

- Checar respostas em lote e identificar padrões (erros recorrentes, falhas de autenticação, etc.);

- Integrar automações no pipeline CI/CD, exigindo sucesso nos testes antes do deploy.

Automatizar os cenários de teste é um fator-chave para não deixar nenhum caso crítico passar despercebido.

Para quem pensa em avançar no tema automação, recomendo o conteúdo sobre automação de processos fiscais para entender o que é possível testar e automatizar nesse universo.

Monitorando logs e analisando respostas

Quando tudo parece funcionar, é hora de olhar os logs com atenção. Eu sempre ativo níveis mais altos de log (“debug” e “trace”, por exemplo) enquanto testo o ambiente:

- Gravo todas as requisições e respostas, com timestamp;

- Analiso latência, timeouts e falhas de comunicação;

- Verifico se webhooks enviados pela API estão chegando e sendo processados corretamente;

- Cruzo logs de banco de dados com logs de requisições, buscando inconsistências.

Se notar lentidão, requisições duplicadas ou ausência de callbacks, é hora de revisar a infraestrutura: ajustes de fila, tratamento assíncrono, análise do gateway, ou até revisão do código. O Notaas ajuda ao fornecer webhooks desde o plano gratuito, agilizando o ciclo de feedback na integração.

Se notar lentidão, requisições duplicadas ou ausência de callbacks, é hora de revisar a infraestrutura: ajustes de fila, tratamento assíncrono, análise do gateway, ou até revisão do código. O Notaas ajuda ao fornecer webhooks desde o plano gratuito, agilizando o ciclo de feedback na integração.

Erros comuns que acompanhei no setup de testes

Quero relatar alguns deslizes que frequentemente observo e que podem ser evitados com simples revisões:

- Usar token ou certificado de produção em ambiente de testes (ou vice-versa);

- Confundir endpoints: emitir NFS-e real usando endpoint de homologação;

- Testar alto volume sem proteção, causando bloqueios por parte da prefeitura ou do provedor da API;

- Ignorar limites de envio estabelecidos na documentação, levando a erros de quota;

- Deixar dados sensíveis de teste expostos, sem limpar depois;

- Não verificar corretamente os retornos: considerar o simples HTTP 200 como sucesso, sem ler o corpo da mensagem;

- Não documentar scripts, payloads e dados simulados, dificultando futuras manutenções.

Registrar aprendizados durante a configuração facilita posteriores correções e escalar o ambiente sempre que preciso.

Melhorando o ambiente: automação, CI/CD e deploy real

Com o ambiente estável, abro espaço para três melhorias que transformam qualquer integração fiscal:

Automação de testes e integração contínua

Adiciono rota automatizada dentro do CI/CD (por exemplo, GitHub Actions, GitLab CI) acionando scripts que rodam chamadas completas à API NFS-e a cada novo deploy. Isso já impediu que “pequenas mudanças” passassem despercebidas e chegassem à produção causando transtornos.

Simulação de cenários reais e edge cases

Gosto de simular cenários diferentes além do “fluxo feliz”: notas com valores zerados, CNPJs inválidos, datas retroativas, notas canceladas em massa, envio com e sem webhooks, falhas inesperadas de rede, timeouts. Isso me ajuda a conhecer o comportamento real da API, principalmente quando uso a arquitetura assíncrona, como a do Notaas.

Deploy: preparando passagem do teste para produção

Na minha rotina, o deploy não é só “subir código”. Inclui:

- Revisão das credenciais: garantir que estão corretas para produção;

- Validação minuciosa dos endpoints e configuração de variáveis de ambiente;

- Reset de logs e ajustes para contexto real;

- Ativação de alertas e monitoramento para as primeiras horas de operação;

- Teste real de ponta a ponta: da requisição ao recebimento do webhook, e armazenamento final no banco de dados de produção.

Se passar por todos esses checkpoints, abro a operação real com tranquilidade, certo de que riscos fiscais, financeiros e operacionais estão sob controle.

Se passar por todos esses checkpoints, abro a operação real com tranquilidade, certo de que riscos fiscais, financeiros e operacionais estão sob controle.

Checklist final: revise antes de avançar para produção!

Antes de finalizar o ambiente de testes e planejar o deploy, deixo aqui um checklist prático, na mesma ordem que sigo sempre:

- Ambientes totalmente separados (produção e testes);

- Documentação entendida e consumida por todos os envolvidos;

- Certificados digitais instalados e testados;

- Dados simulados preparados, validados conforme o município;

- Testes manuais e automáticos realizados com sucesso;

- Logs monitorados, sem erros recorrentes;

- Webhooks recebidos e processados corretamente;

- Alertas configurados para incidentes;

- CI/CD operando com scripts de teste acionados em todo deploy;

- Checklist documentado com aprendizados e ajustes feitos.

Com isso, você terá a confiança de que o processo está bem estruturado e pronto para atender à legislação municipal com o máximo de segurança.

Caso surja interesse, recomendo fortemente navegar pela categoria de APIs fiscais no blog do Notaas, onde abordo desde dicas de integração e dúvidas sobre schemas até temas de LGPD e segurança de dados fiscais.

Como ambientes de teste impulsionam a automação fiscal

Minha experiência mostra que, sem testes sólidos, a automação fiscal nunca funcionará direito. E plataformas como o Notaas trazem diferenciais gigantes, como arquitetura assíncrona nativa, webhooks no plano gratuito e estrutura pensada para escala, isso tudo facilita muito a vida de quem deseja implantar rotinas fiscais automatizadas sem medo.

Para quem tem projetos SaaS, ERPs ou é desenvolvedor responsável por vários clientes, recomendo conhecer o conteúdo sobre NF-e e acompanhar novidades do mercado. O caminho entre o ambiente de testes e o deploy deve ser cada vez mais curto, ágil e seguro.

Conclusão: invista na qualidade do teste para ter resultados reais

Se tivesse que resumir tudo o que vi, aprendi e corrigi nos últimos anos trabalhando com APIs NFS-e, seria: o sucesso do seu projeto depende de ambientes de teste robustos, automatizados e constantemente atualizados. Não há atalhos aqui. Os detalhes fazem toda a diferença e qualquer falta de atenção pode trazer impacto direto em dinheiro, na confiança do cliente e até em fiscalizações indesejadas.

No Notaas, cuidamos para que desde o plano gratuito já seja possível operar com segurança, recebendo webhooks em tempo real, painéis intuitivos, facilidade de integração e possibilidade de white label para quem precisa ir além.

Então, se você quer garantir a precisão da emissão fiscal dos seus sistemas, venha conhecer o Notaas e experimente na prática como nossa plataforma pode transformar a relação da sua empresa com as notas fiscais eletrônicas. Aposte em ambientes de teste sérios, tenha o controle no seu desenvolvimento e comece a emitir NFS-e com rapidez e segurança total.

Perguntas frequentes sobre ambiente de teste para API NFS-e

O que é uma API NFS-e?

Uma API NFS-e é um serviço digital que permite emitir Notas Fiscais de Serviço Eletrônica (NFS-e) de maneira automatizada e integrada a sistemas, plataformas e ERPs. Por meio de requisições HTTP (geralmente usando o padrão REST) com dados do prestador, tomador e do serviço, é possível emitir, consultar, cancelar e listar notas fiscais, recebendo respostas padronizadas. Um dos maiores ganhos da API NFS-e está na eliminação de processos manuais, redução de erros humanos e integração escalável para múltiplos clientes, municípios e regras fiscais. A API do Notaas, por exemplo, traz ainda facilidade para operar em diferentes cidades sem necessidade de múltiplas integrações.

Como montar ambiente de teste NFS-e?

Para montar um ambiente de teste NFS-e, recomenda-se separar totalmente a infraestrutura de produção, criar banco de dados próprios para teste, usar sandbox da API, configurar certificados digitais e gerar dados simulados para testes. Adote ferramentas como Postman ou scripts próprios para validar todas as rotas da API, ative logs detalhados e organize checklists para validar fluxos completos, dos envios ao recebimento de webhooks. Lembre de seguir sempre documentação e recomendações do provedor para manter o ambiente protegido e atualizado.

Quais ferramentas preciso para testar NFS-e?

Entre as ferramentas essenciais para testar NFS-e estão ambientes sandbox das APIs, geradores de dados simulados, clientes de API como Postman ou Insomnia, scripts em Python ou Node.js, sistemas de log detalhado e recursos para automação de testes dentro do CI/CD. Ferramentas especializadas permitem simular cenários extremos, validar diferentes respostas da API, medir performance, automatizar fluxos e garantir repetibilidade nos testes antes de fazer o deploy real para a produção.

Como fazer o deploy da API NFS-e?

O deploy da API NFS-e começa com a validação total do ambiente de testes: revise credenciais, configure variáveis de ambiente, revalide endpoints e certifique-se que logs, notificações e webhooks estão ativos. Inclua passos de automação nos pipelines CI/CD, realize um teste real (end-to-end) usando dados reais de produção e monitore as primeiras horas após o deploy para identificar qualquer eventualidade. Assim o processo ocorre sob controle, mitigando riscos técnicos e fiscais.

Testar a API NFS-e é obrigatório?

Embora não haja uma obrigação legal expressa para o desenvolvedor, testar a API NFS-e é indispensável para garantir segurança, legalidade e compliance fiscal. Falhas na emissão, envio de dados errados ou uso incorreto de webservices podem resultar em notas inválidas, rejeições fiscais e prejuízo direto ao negócio. A recomendação, tanto técnica quanto jurídica, é investir na qualidade e segurança dos testes antes de expor clientes ou operações reais à emissão fiscal automatizada.